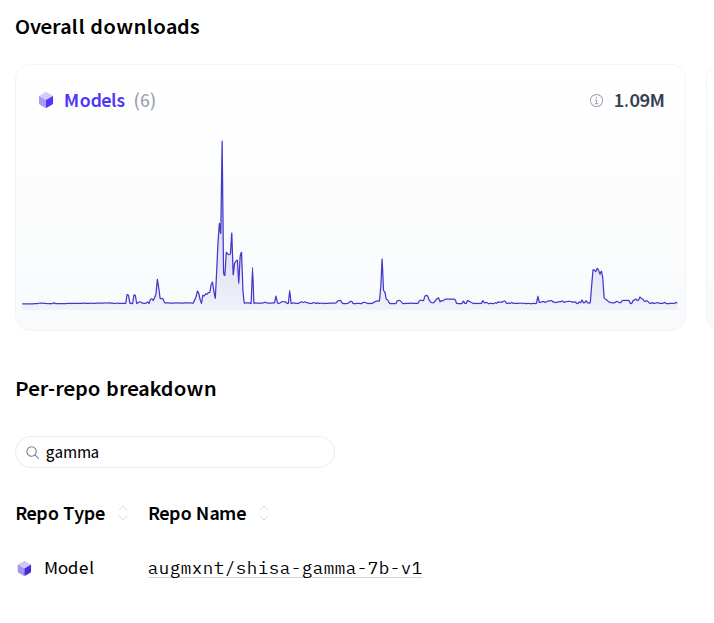

Shisa-Gamma-7b-v1のダウンロード数が100万回を突破

公開から1年を経て、当社のモデルがコミュニティで広く活用されていることを改めて実感しています。

Sakana AIによるLLMの進化的モデルマージに関する研究の発表から1年が経過しました。この研究では、当社のshisa-gamma-7b-v1が日本語バックボーンモデルとして採用されました。この重要な成果は、今年1月にNature Machine Intelligence誌にも掲載されました。

当初の予想を大きく上回り、shisa-gamma-7b-v1の累計ダウンロード数が100万回を突破いたしました。このモデルは、Weights & Biasesが運営する日本語LLMリーダーボード「Nejumi LLM Leaderboard」において、昨年を通してトップクラスの評価を維持しました。

現在、当社では次世代のshisa-v2-llama3.1-8b-previewの開発を進めております。本モデルは、従来比で大幅な性能向上を実現し、効率的なトークナイゼーションと広いコンテキストウィンドウを提供します。ぜひ新しいモデルもお試しください。

最後に、本プロジェクトの実現を支えてくださったMistral AIチーム、Stability AI Japan、そしてJon Durbin氏をはじめとするオープンソースAIコミュニティの多大なる貢献に深く感謝申し上げます。

ほかのニュース

Shisa 7B リリース

合成データ駆動アプローチを用いたバイリンガル汎用チャットモデルです。

続きを読むShisa.AI、国内最高性能の多言語対応LLMを開発

GPT-4を上回る日本語処理能力を誇る、405BパラメータのオープンソースLLMを公開。

続きを読む